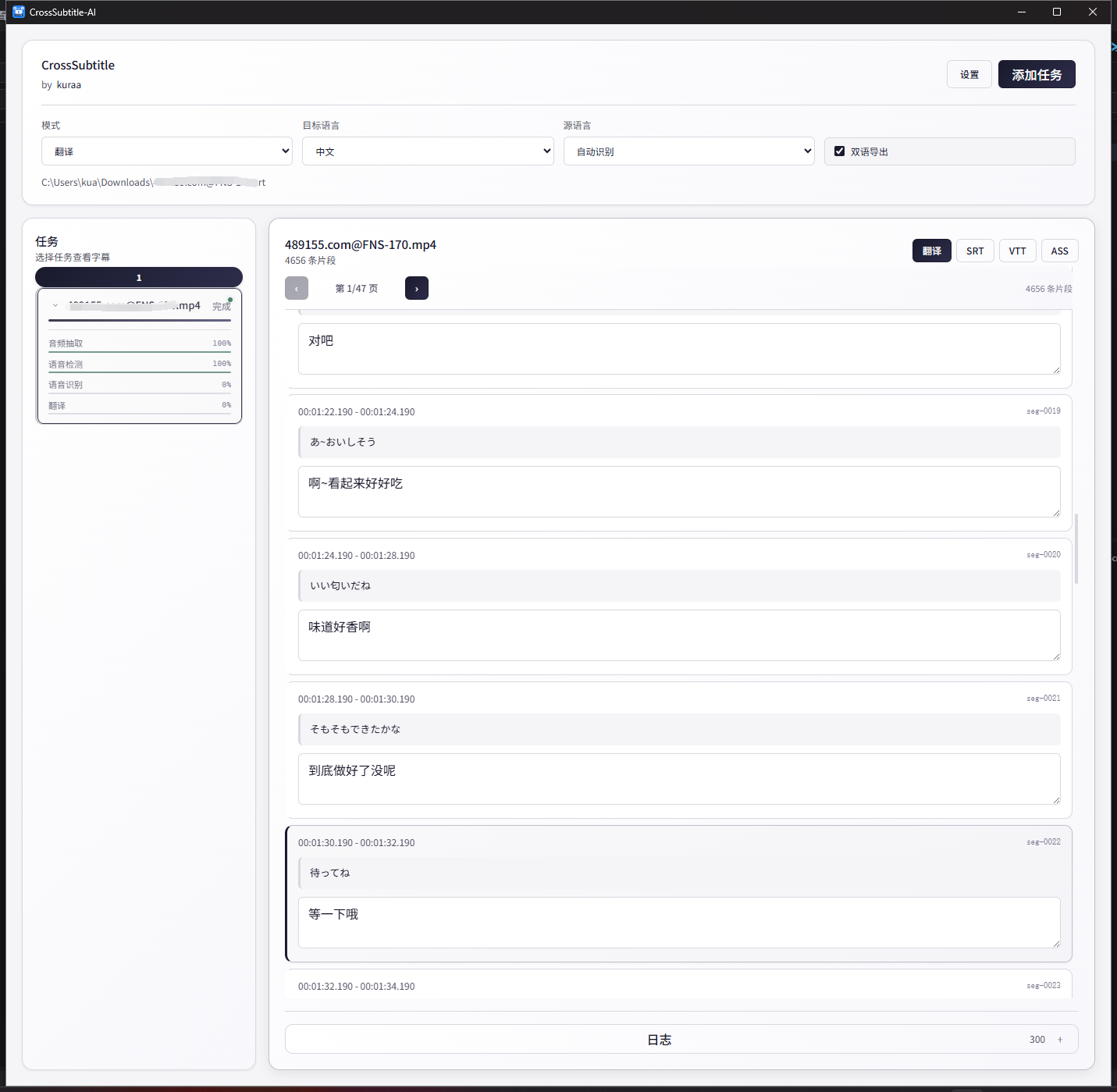

用AI做了一个给小电影加字幕的工具

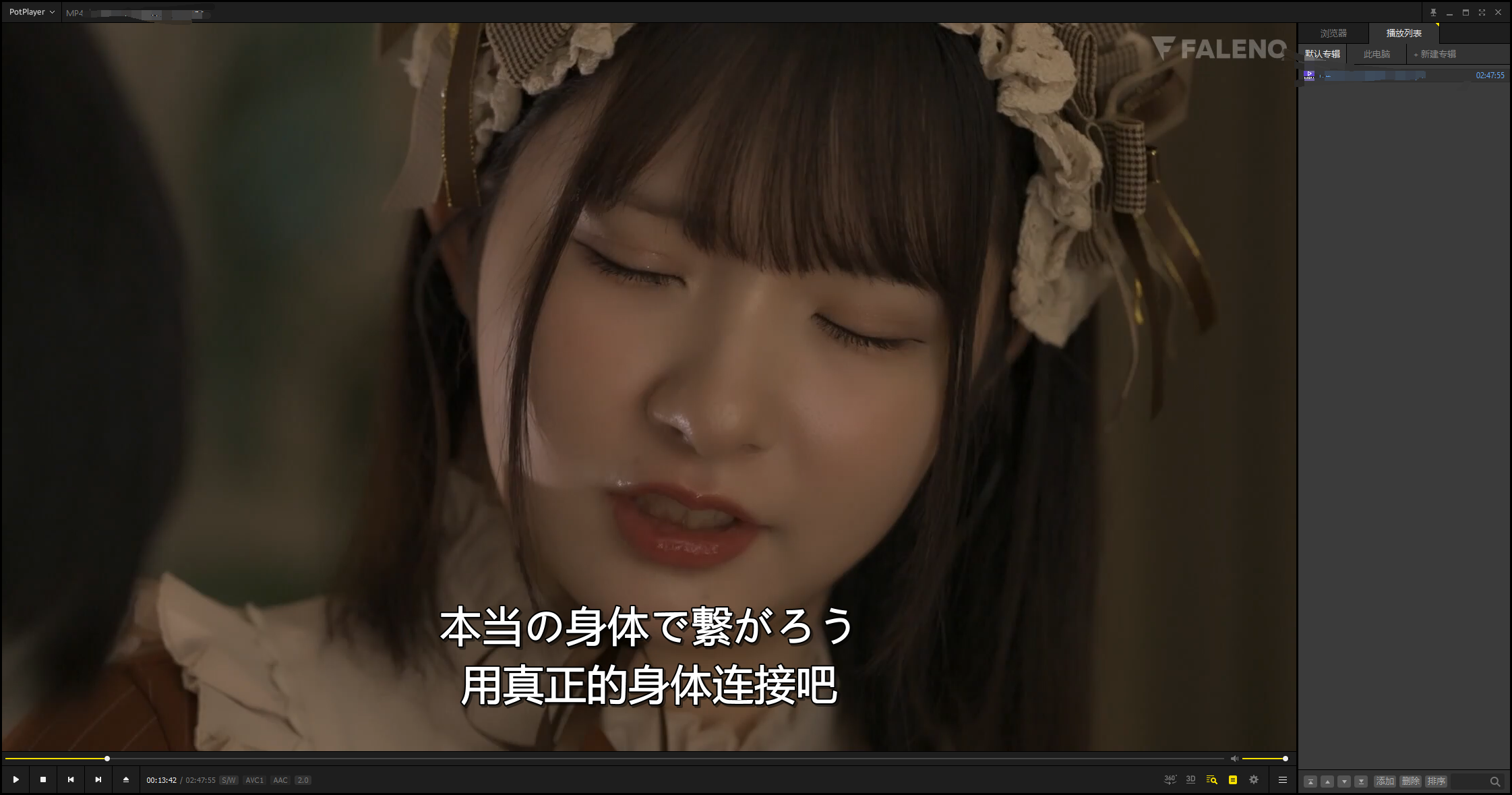

年纪越来越大,也越来越关注剧情了。

以前看看小日子的影片,可能更关注别的内容😀;现在反而经常会想:他们到底在聊什么?这什么逆天的人物关系?剧情推进到哪一步了?

听不清他们在说什么;翻遍互联网,也找不到现成字幕。

NAS里上百个小姐姐,字幕哪能配得齐全。

于是,趁着当下 vibe coding 火热,决定拿这个需求试试水,顺手做了个工具。

需求其实很简单

核心目标只有三个:

把视频里的日语、英语语音识别出来

翻译成中文字幕

自动生成字幕文件,并尽量做到开箱即用

先让 AI 帮我做方案调研

用网页版 ChatGPT 做技术调研,梳理整个方案:

本地语音识别用什么模型

桌面端框架怎么选

字幕时间轴怎么处理

翻译层怎么接入

确认ok,开始ai梭哈。

全程 AI 编程:Codex + DeepSeek V4

基本全程交给 AI 协作完成。

主要组合是:

Codex:负责代码实现、逻辑补全、工程推进

DeepSeek V4:负责前端界面、样式优化、交互调整

说句实话,Codex 的审美真是烂完了。

无论你怎么提示,它做出来的界面总有一种:

临时拼出来的 demo 风

按钮随便摆一摆

间距狗屎

但却是能run

后续也测试了mimo2.5-pro,glm 5.1

mimo最大的问题是容易断连,智谱glm 就纯诈骗了,10个问题,9个超时或429,马勒戈壁的智谱什么时候给我退款!!!

果然国产扛大旗的还得是deepseek啊,在DeepSeek V4 发布后第一时间开始试用,简直超出想象,逻辑深度真的非常ok,并且也非常便宜。

但问题还是项目过于复杂时,感官上好像没有gpt5.5聪明。其它时候也感受不出差别,保守评测,和5.4中等差不多水平吧,也很是满意了。

但 DeepSeek V4 在 UI 上的表现出乎意料,比较符合我对工具类软件的要求:

极简

清爽

不花哨

所以最后该项目相当于是codex与deepseek混合着开发。

也发现一个很好笑的,原本在作者栏留下了我和gpt的名字,但deepseek接手时,就默默把gpt去掉了哈哈哈哈哈,于是手动改成“作者:kuraa,gpt,deepseek”,但codex又会把deepseek去掉:)。

目前这个工具最大的难题

目前没有内置翻译引擎。

这意味着用户需要自己填写:

OpenAI API Key

DeepSeek API Key

或其他兼容接口

对于熟悉 AI 工具的人来说,这不算问题。

但对于普通用户而言:

什么是 API Key?

去哪申请?

为什么还要充值?

Base URL 又是什么?

这些步骤足以劝退很多人。

我想过把模型内置进去

最开始也考虑过:直接塞一个本地小模型进去,离线翻译。

听起来很美好,但现实是:

即便是“小模型”,你仍然需要:

模型文件

推理框架

Runtime 依赖

各平台兼容支持

这几个东西加起来,怎么也得接近 1GB 甚至更多。

而我做的是桌面小工具。

一个“加字幕软件”安装包 1GB+,用户看到体积就先关网页了。

也想过 WebView 白嫖浏览器翻译

后来我又想到另一个方向:

既然桌面端用了 WebView,能不能直接调用浏览器已有翻译能力?

理论上很香:

无需 API Key

无需模型下载

包体积小

用户零门槛

但实际落地后发现问题也不少:

平台兼容性不一致

可控性差

翻译结果格式难约束

批量文本处理体验一般

最大问题是,效果很差啊,没有上下文,特别是日文这种啰里啰唆的语言,单句翻译效果很不好。

所以这个方案暂时还在观察。

做完后最大的感受

以前遇到这种小需求,大多数人会想:

算了,忍忍吧。

市面上应该没人做。

太小众了。

但铁汁!AI 时代来了!!!

如果不是为了使用流畅与美观,核心功能基本2两小时就搞完了!

以后不需要古法编程了:(

好了,地址在这儿,感谢小伙子们使用。

https://git.kuraa.cc/kura/crosssubtitle-ai